▲사진=검색 엔진이 딥페이크 포르노를 검색 결과 상단에 노출시키는 문제를 제기한 아스테크니카 기사

구글 등의 검색 엔진이 딥페이크 포르노를 검색 결과 상단에 노출시키고 있는 것으로 드러났다고 지난 1월 11일(현지시간) IT매체 아스테크니카가 전했다.

딥페이크 포르노는 인공지능(AI)의 발전으로 인해 암시장에서 급성장하고 있는 콘텐츠로, 성인 연예인의 신체에 다른 유명인의 얼굴을 겹쳐 실제 성관계를 하는 것처럼 보이게끔 한다.

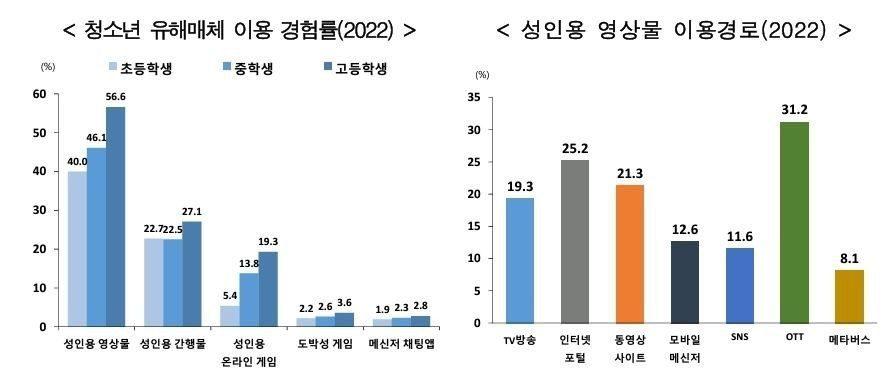

유명인뿐만 아니라 일반인과 어린이에게도 영향을 미치고 있다. 아동 안전 전문가들은 온라인에서 거래되고 있는 수천 개의 사실적인 가짜 AI 아동 성행위 이미지를 발견했으며, 미 연방수사국(FBI)은 성착취 사기에 AI가 생성한 딥페이크의 사용이 증가하고 있다고 경고했다.

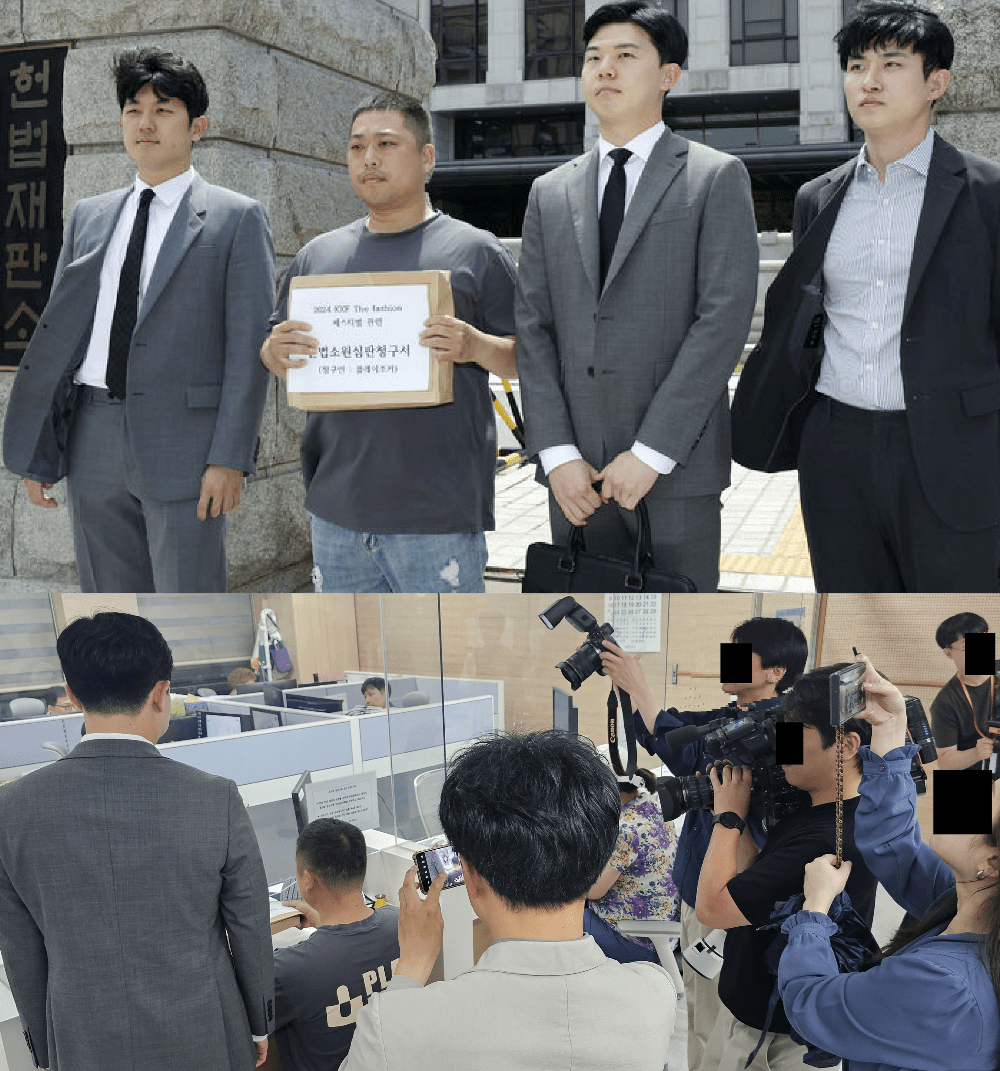

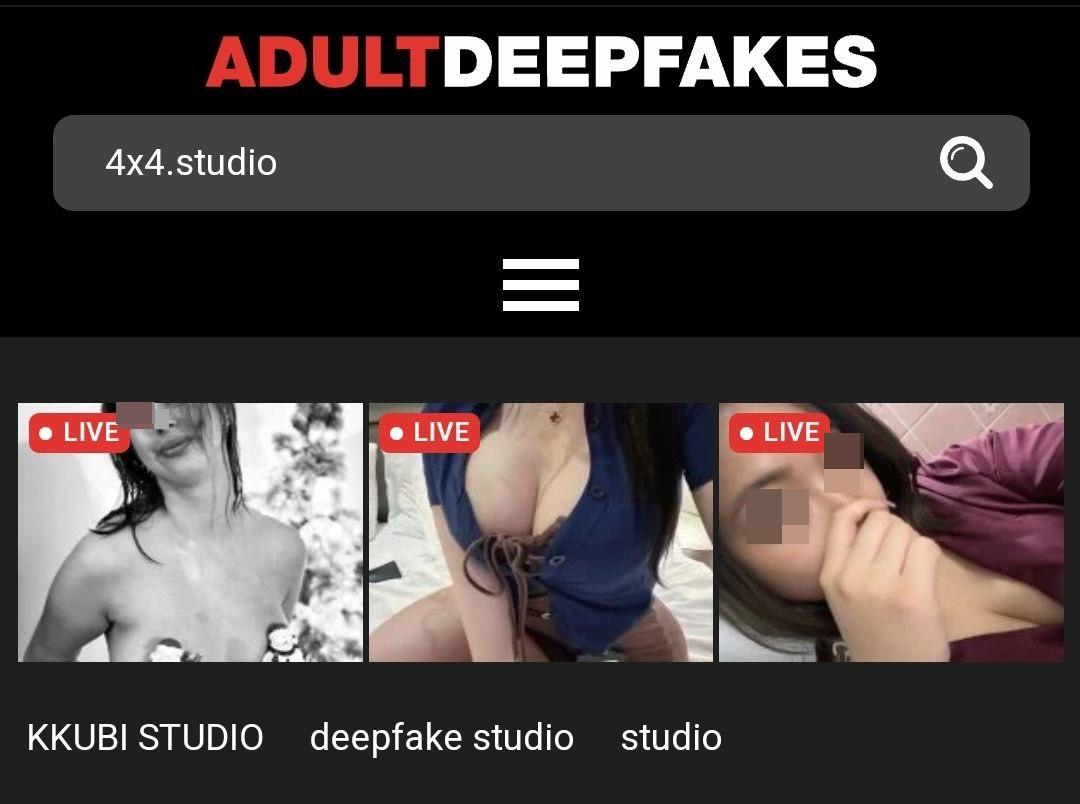

▲사진=구글에 딥페이크 포르노를 치면 다음과 같은 화면이 나오는 사이트와 연결된다.

딥페이크 포르노의 증가가 멈출 기미를 보이지 않자, 미국의 일부 주(州)에서는 딥페이크 포르노 배포를 범죄화하는 법을 통과시켰다. 구글 역시 “딥페이크 포르노로 인한 피해자가 얼마나 고통스러울지 이해하기에 검색에 더 많은 보호 기능을 제공하기 위해 노력하고 있다”며 “그러나 구글은 웹에 존재하는 콘텐츠를 색인화하기 때문에 이러한 논란의 여지가 있는 콘텐츠가 때때로 나타난다”고 설명했다.

구글은 자사의 검색 기능이 조작된 미디어나 성적으로 노골적인 콘텐츠를 허용하지 않는다고 말했지만, NBC 뉴스의 조사 결과 그렇지 않은 것으로 밝혀졌다.

[한국성인콘텐츠협회 kacaorkr@gmail.com]